日本語の音声認識を徹底解説!仕組みや精度を高めるコツも紹介

業界トップの正確率で作業効率爆上げ!

日本語の音声認識を試してみたいけど、そもそもの仕組みを知りたい

思うように音声認識の精度が上がらない

音声認識エンジンにはどのようなものがあるのか知りたい

こんな悩みを抱えていませんか?

AI技術の急速な進歩により、音声認識に対する興味を持っている方もいると思います。

この記事では以下について解説します。

音声認識とは

音声認識の仕組み

日本語の音声認識の精度

音声認識エンジン

ChatGPTの登場により注目が集まっている、テキスト領域と親和性の高い音声に関する現状をお伝えします。

これまで音声認識やAIに触れたことがない方にも分かりやすいように、丁寧に解説しますので最後までご覧ください。

音声認識とは

音声認識とは、人間が話す言葉をテキストデータに変換する技術です。

AI(人工知能)を使った音声認識は、近年急速に進化しておりスマートフォンやスマートスピーカーなどの製品で幅広く利用されています。

代表的な製品である「Siri」は、使ったことがある人も多いのではないでしょうか。

音声認識技術は、多層のニューラルネットワークを使って複雑なデータを解析するAI手法「ディープラーニング」を活用しています。

ディープラーニングは大量の音声データを学習して、人間の声や発音のパターンを理解できる点が特徴です。

この技術によって、さまざまな言語やアクセントに対応した音声認識が可能です。

海外では自動車や家電、医療分野など様々な産業で利用が広がっています。

例えばアメリカでは、Amazon EchoやGoogle Homeといったスマートスピーカーが家庭で一般的に使用されており、音声コマンドで家電操作や情報検索ができます。

音声認識技術の普及に伴い、プライバシーやセキュリティへの懸念が増えていることも事実です。

音声データが不適切に取り扱われることで、個人情報の漏洩や悪用が起こる可能性があるため、データ保護やセキュリティ対策が重要です。

今後の音声認識技術には、多くの産業や人々の生活に貢献することが期待されています。

技術の普及に伴う懸念事項に対して、適切な対策とバランスを取りながら発展を続けていくでしょう。

音声認識の仕組み

ここでは、どのように音声認識がされているのかを解説します。

大きく以下の3つのステップによって、人間が発した音声がテキストに変換されています。

1.音声を聞き取る

2.音声データを解析する

3.テキストに変換する

ひとつずつ解説します。

1.音声を聞き取る

発話された音声は、マイクなどを使って電気信号に変換し音声データとして聞き取られます。

例えばSiriやGoogleアシスタントなどに代表される音声アシスタントは、私たちの声を音声データに変換しています。

音声認識の精度に大きく影響するため、正確に音声を聞き取ることが重要です。

そのため周囲の騒音や話す人の声の大きさ、話し方などに注意しましょう。

騒音が多い環境では音声を聞き取れず、音声認識の精度が低くなることがありますので、静かな環境や適切な距離で話すことを心がけてください。

またマイク自体の性能も、音声認識の精度に影響します。

高性能なマイクは音声をより正確に聞き取り、クリアな音声データを生成することが可能です。

音声認識技術が音声データを正確に解析することで、テキストへの変換がスムーズに行われます。

音声を聞き取る段階で得られた音声データは、次の「音声データを解析する」ステップに進みます。

2.音声データを解析する

マイクで聞き取られたデータを解析する段階でAIが登場し、音声データに含まれる言葉やフレーズを理解しようと試みます。

はじめにAIは、音声データの中から個々の音素を識別します。

音素とは母音や子音などのように、言葉を構成する最小単位の音のことです。

音素を識別することで、AIは言葉の発音やアクセントを理解することが可能です。

次にAIは文法や文脈を考慮しながら、音素を言葉やフレーズに組み立て直します。

日本語の場合であれば、助詞や文末表現を認識して文の構造を理解しようとします。

また似たような発音でも文脈によって意味が変わる言葉があるため、前後の言葉などを解釈して正しい意味を把握しなければいけません。

さらに複数の話者を正確に認識し、アクセントや話し方、速さなども考慮して音声データを解析しています。

過去のデータや学習を通じて、音声認識の精度を徐々に向上させている点もAIの音声認識の特徴です。

解析された結果は、「テキストに変換する」ステップに渡されます。

3.テキストに変換する

次のステップは「テキストに変換する」です。

まずは解析した音素や単語、フレーズを組み合わせて、一連の文を作成します。

例えば「こんにちわ」や「おげんきですか」といった音声データを、テキスト形式の「こんにちは」「お元気ですか」と出力します。

次は文法や文脈を考慮して、適切な句読点や大文字・小文字の使用など正しいテキスト表現に変換する作業です。

例えば「わたしのなまえはたろうです」という音声データがあれば、AIは「私の名前は太郎です。」とテキストに変換します。

日本語の文法や一般的な表現を考慮して、適切な句読点や、漢字・ひらがな・カタカナを使い分ける処理をおこなっています。

さらに、話し言葉の特徴を考慮することも重要です。

例えば「えーっと、あのー」といった音声や、無意味な繰り返しを省略して、自然なテキストを生成できます。

日本語の音声認識の精度は?

日本語の音声認識の精度は、決して高くないのが現状です。

ここでは、日本語の精度が低い原因と、精度を向上させるための対処法を解説します。

精度が低い原因

日本語の音声認識の精度が低いのは、文法が複雑である点が原因です。

主語や目的語が省かれることが多く、文の流れから意味を推測する必要があります。

助詞の使い方や活用形も幅広く、適切に解析するのが難しいとされています。

あわせて精度の低下に影響しているのは、同音異義語が多い点です。

例えば「はし」であれば「橋」「端」「箸」のように、同じ発音で異なる意味や漢字を持つ単語が多く存在します。

文脈から言葉を選んではいるものの、音声として同じ言葉を適切に判断するのは困難です。

さらに地域によってアクセントのパターンが異なる点も、日本語が難しい特徴のひとつです。

特に地方のアクセントの場合は学習データが少ないため、同じ単語でもAIの認識精度が下がります。

精度を向上させる対処法

日本語の音声認識の精度を向上させる対処法のひとつは、学習データを充実させることです。

音声認識AIが大量の音声データを学習し、音声のパターンを把握することで、より正確な認識を行えるようになります。

アクセントや口語表現、方言なども含めた学習データを作成すれば、精度向上につながります。

加えて音声認識AIが認識できる単語を増やすことも、精度の向上に有効な対処法です。

一般的な単語だけでなく専門用語や地名なども含めた、充実した辞書を学習させることが必要です。

また話者としてはできるだけ専門用語を使わず、アクセントも標準語に近づけて話すことが精度向上のカギになります。

多くの学習データにより、今後も音声認識の精度が上がることが予想されます。

さまざまな改善が繰り返されているため、機械的な精度も上がる可能性もありますが、話す人間もできるだけAIが聞き取りやすい言葉を話しましょう。

日本語の音声認識エンジンまとめ

ここでは、日本語を認識できるエンジンについて解説します。

海外のエンジンに加え、日本の企業が展開している音声認識エンジンも紹介しますのでぜひご覧ください。

海外(Whisper)

「Whisper」はOpenAI社が公開した、音声認識モデルです。

無料で文字起こしができるサービスとして公開されていて、Web上にある68万時間ものデータを学習しています。

英語では人間と同等レベルの性能を発揮し、日本語を含む多くの言語で音声認識だけでなく翻訳、言語認識なども可能です。

日本語の精度は公開されている「単語誤り率」で6位(5.3%)であることから、比較的高い精度で認識できることが分かります。

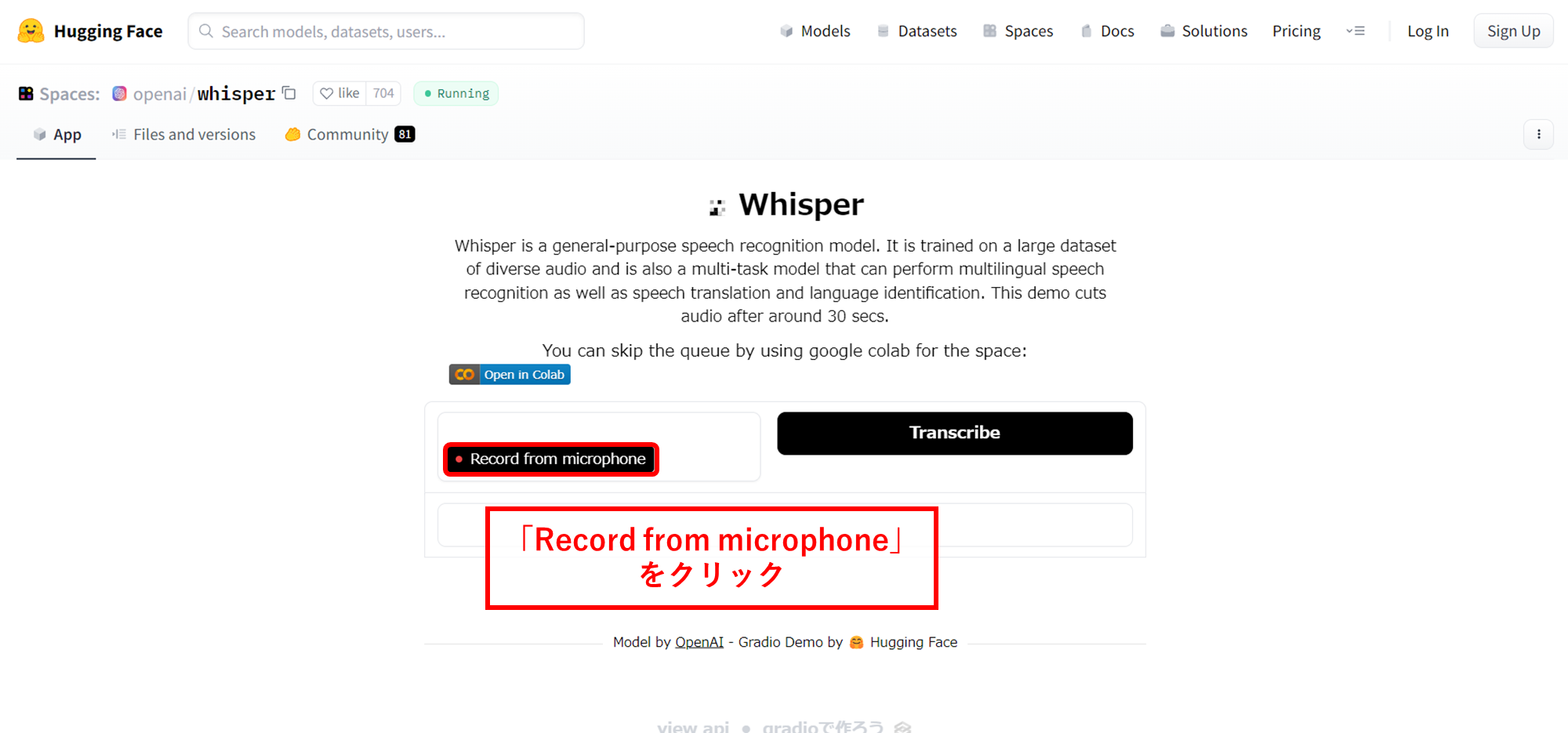

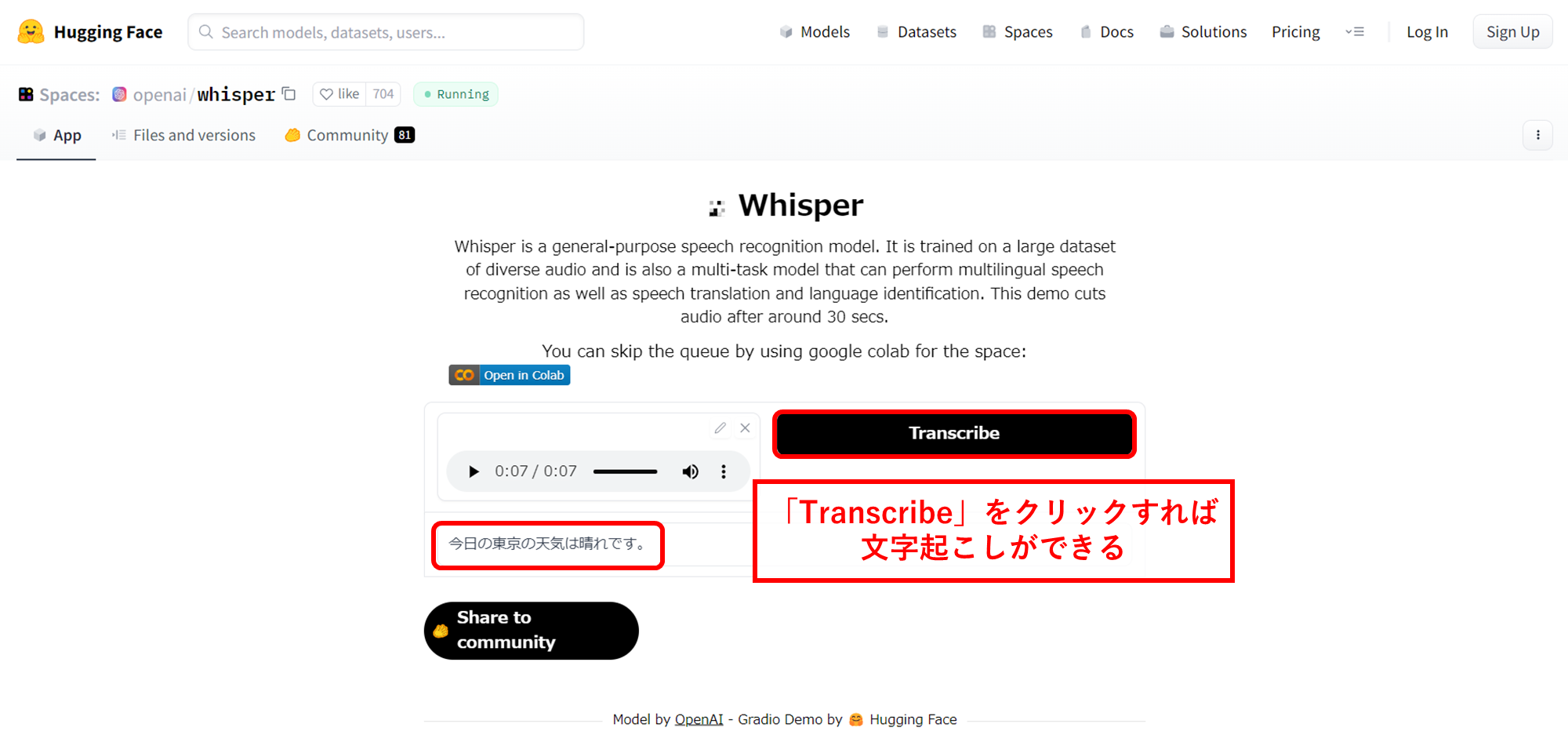

試しに使ってみたい方は、オープンソースコミュニティ「Hugging Face」がおすすめです。

画像のように、2クリックで簡単に文字起こしを試せます。

日本国内(AmiVoice)

「AmiVoice」は、東京に本社を置く「株式会社アドバンスト・メディア」が開発した音声認識エンジンです。

20年以上のノウハウやデータが蓄積された高精度かつ高速のエンジンで、日本語に対する高い認識精度に定評があります。

社内に持っている独自の研究部門により、最新技術やデータを使った分析やチューニングが行われています。

最新のディープラーニング技術などをエンジンに実装することで、高い認識率を実現しています。

またAmiVoiceは自然な話し方でも認識できるため、話し方を変える必要はありません。

アクセントや会話スピードなどに関わらず、自然な発話を認識することが可能です。

業務に不適切な用語を省略することで、誤認識を軽減したビジネスユースに強い言語モデルを使用している点も特徴です。

もちろん、製品名や固有名詞などの登録・認識も可能です。

文字起こし精度を高めるコツ3選|AI文字起こしサービスNotta

Nottaは日本語に特化した国内最先端AI音声文字起こしツールです。

まとめ

今回は、日本語の音声認識について解説しました。

記事の内容をまとめると以下のとおりです。

音声認識とは人間が話した言葉をテキストに変換するための技術

仕組みは「聞き取る」「解析する」「テキストにする」の3ステップ

日本語の音声認識の精度は高くない

2023年に入りChatGPTなど、テキスト領域のAI技術が飛躍的に発展しています。

もちろん音声におけるAI技術も、発展を続けることは間違いありません。

早いうちにAIツールに触れて、最新情報に取り残されないようにしましょう。

AIを使った自動文字起こしサービスは「Notta」がおすすめです。

無料で体験できて、58の言語に対応していますので今すぐ始められます。

最新のAI技術を試したい方は、Notta式ホームページから試してみてください。